Новости

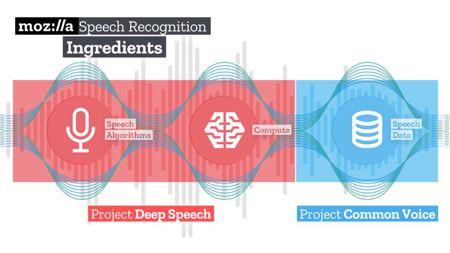

Проект Mozilla опубликовал первый выпуск модели для системы машинного обучения, ориентированной на распознавание речи. Также опубликован использованный для тренировки модели набор голосовых данных, собранный в результате инициативы Common Voice и включающий примеры произношения около 20 тысяч людей, которые надиктовали почти 400 тысяч записей суммарной продолжительностью 500 часов.

Благодаря участию в проекте большого числа добровольцев, удалось сформировать одну из крупнейших баз голосовых шаблонов, учитывающих всё разнообразие голосов и манер речи. Собранная база позволила натренировать модель для системы машинного обучения до уровня распознавания речи, при котором число ошибок примерно соответствует распознаванию обычным человеком при прослушивании тех же записей. В текущем виде число ошибок распознавания составляет 6.5% при использовании тестового набора LibriSpeech. Для сравнения, уровень ошибок при распознавании человеком оценивается в 5.83%, а уровень ошибок при работе Google Speech составляет 6.64%, wit.ai — 7.94%, Bing Speech — 11.73%, Apple Dictation — 14.24%.

В основе системы распознавания речи Mozilla лежит движок DeepSpeech, созданный с использованием открытой компанией Google платформы машинного обучения TensorFlow. DeepSpeech реализует в коде одноимённую архитектуру распознавания речи, предложенную исследователями из компании Baidu. Предложенный Mozilla набор помимо модели распознавания речи и примеров произношения включает готовые к применению модули для Python и NodeJS, позволяющие без лишних усложнений встроить в свои программы функции распознавания речи. Также поставляется инструментарий для распознавания из командной строки. Движок распознавания речи достаточно быстр и не требователен к ресурсам, что позволяет использовать его даже на платах Raspberry Pi.

DeepSpeech значительно проще традиционных систем и при этом обеспечивает более высокое качество распознавания при наличии постороннего шума. В разработке не используются традиционные акустические модели и концепция фонем, вместо них применяется хорошо оптимизированная система машинного обучения на основе нейронной сети, что позволяет обойтись без разработки отдельных компонентов для моделирования различных отклонений, таких как шум, эхо и особенности речи. Особенностью DeepSpeech является то, что для получения качественного распознавания данная архитектура требует большого объёма разнородных данных для осуществления обучения, надиктованных в реальных условиях разными голосами и при наличии естественных шумов.

Опубликованный набор голосовых данных не ограничен применением в DeepSpeech и может оказаться полезным и для других открытых проектов, занимающихся распознаванием речи, таких как Sphinx, Kaldi, VoxForge, ISIP, HTK и Julius. До сих пор исследователям и разработчикам были доступны только ограниченные наборы голосовых данных, а стоимость полноценных коллекций голосовых выборок исчислялась десятками тысяч долларов, что сильно тормозило независимые исследования в области распознавание речи. В настоящее время работа сосредоточена только на распознавании английского языка, но в первой половине 2018 года планируется приступить к сбору примеров произношения для других языков.

Источник: blog.mozilla.org

вернуться к списку новостей